Ist Ihnen aufgefallen, wie schnell sich die Technologie in letzter Zeit entwickelt? Es scheint so, als gäbe es jeden Tag ein neues KI-Tool oder einen erstaunlichen neuen Dienst, der auftaucht. Nun, all diese Leistung braucht ein ernsthaftes Zuhause, und offen gesagt, das traditionelle CPU-zentrierte Rechenzentrum ist einfach nicht mehr zeitgemäß. Die Welt der Unternehmensdatenverarbeitung verändert sich rasant, und GPUs - diese leistungsstarken Chips, die wir früher nur für Videospiele kannten - sind jetzt das Motor dieses neuen digitalen Zeitalters.

Wir reden hier nicht nur über eine kleine technische Aktualisierung. Wir sprechen von einer grundlegenden Überarbeitung der Architektur. Die Nachfrage nach paralleler Rechenleistung ist so groß, dass Unternehmen es sich nicht leisten können, sie zu ignorieren. Sie fragen sich vielleicht, warum der plötzliche Bedarf an einer GPU-optimierten Umgebung? Das liegt daran, dass die moderne Arbeitslast völlig anders ist.

Das Kernproblem: Warum Ihre alte Hardware nicht mehr taugt

Stellen Sie sich eine herkömmliche CPU als einen brillanten Buchhalter vor, der perfekt für sequenzielle Aufgaben geeignet ist: erst A, dann B, dann C. Sie ist intelligent und zuverlässig, aber sie ist ein riesiger Engpass für umfangreiche, gleichzeitige Aufgaben.

Eine GPU hingegen ist etwas völlig anderes. Sie verhält sich wie ein Team aus Tausenden von spezialisierten Arbeitern. Sie alle bearbeiten Teile desselben riesigen Problems auf einmal. Sie sind speziell konzipiert für Parallelverarbeitung, Das macht sie zur bevorzugten Architektur für die komplexesten Aufgaben von heute. Das ist nicht der Server Ihres Großvaters; das ist spezialisierte Pferdestärke.

Ein grundlegender Wechsel zur Parallelverarbeitung

Wenn Algorithmuszentren oder Forschungseinrichtungen umfangreiche Simulationen durchführen oder die nächste Generation von KI-Modellen trainieren, wirkt sich die dafür benötigte Zeit direkt auf ihre Wettbewerbsfähigkeit aus. Verzögerungen bedeuten verlorene Chancen.

Wir brauchen Geschwindigkeit. GPUs bieten genau das. Für spezifische Berechnungen kann ein Grafikprozessor Operationen ausführen hundertmal schneller als eine High-End-CPU. Diese unglaubliche Effizienz ist der Hauptgrund, warum große Unternehmen und sogar kleinere IT-Dienstleister optimierter Hardware den Vorzug geben. Sie ermöglicht die Datenanalyse in Echtzeit und sorgt dafür, dass Ihre bevorzugten Online-Dienste reibungslos funktionieren.

Die harten Fakten: Marktdynamik und Effizienztreiber

Sie müssen nicht nehmen Sie mich einfach beim Wort. Die Zahlen zeigen deutlich, wohin sich die Branche entwickelt. Wenn wir uns die Daten ansehen, erkennen wir, dass es sich nicht um einen vorübergehenden Trend handelt; es ist die Zukunft der Datenverarbeitung auf Unternehmensebene. Wir können doch nicht einfach stillstehen, wenn sich der Markt so schnell entwickelt, oder?

Die folgende Tabelle fasst die wichtigsten Gründe zusammen, warum alle in diese Hardware investieren, und liefert Ihnen die Fakten, die Sie brauchen, um das Ausmaß dieser Veränderung zu verstehen.

| Argument | Spezifischer Punkt/Unterstützende Daten/Beispiel | Quelle |

| Der Markt explodiert | Daten: Der globale Markt für Rechenzentrums-GPUs hatte einen Wert von 19,685,6MillionenimJahr2024∗∗andisexpectedtoreach∗∗19,685,6 Millionen im Jahr 2024** und wird voraussichtlich **19,685,6MillionenimJahr2024∗∗andisexpectedtoreach∗∗ erreichen 230.388.7 Millionen bis 2032. Wachstum: Dies zeigt eine massive CAGR von 36,0% während des Zeitraums. | Kongruenz Markteinblicke |

| KI und ML sind die Haupttreiber | Haupttreiber: Die Notwendigkeit der Einführung von KI treibt 65% des Marktwachstums. Anwendung: Das Trainieren komplexer Deep-Learning-Modelle - wie die von ChatGPT - erfordert die massive Parallelverarbeitung, die nur GPUs bieten. | Kongruenz Markteinblicke, StackGpu |

| Enormer Leistungszuwachs | Technologie: GPUs sind optimiert für Parallelverarbeitung, Dadurch können sie Tausende von gleichzeitigen Berechnungen durchführen. Nutzen: Dies ist von entscheidender Bedeutung für umfangreiche Datenanalysen, komplexe Simulationen und Echtzeitverarbeitung, wie z. B. bei autonomen Fahrsystemen. | StackGpu, TRG Rechenzentren |

| Bessere Energieeffizienz und Kosteneinsparungen | Effizienz: Für parallele Aufgaben werden GPUs oft energieeffizienter als herkömmliche CPUs, wodurch Sie bessere Leistung pro Watt. Ersparnisse: Dies führt zu einer geringeren Gesamtbetriebskosten (TCO), weil man die gleiche Arbeit mit weniger Servern erledigen kann. | Pre Rack IT, SQream |

| Sie treibt die Innovation von Cloud-Diensten voran | Neues Modell: Der Aufstieg der GPU-as-a-Service (GPUaaS) ermöglicht es kleineren Unternehmen, leistungsstarke, KI-optimierte Verarbeitung nach Bedarf zu mieten. Markt: Der GPUaaS-Markt wird von $5,6 Milliarden im Jahr 2024 bis $28,4 Milliarden bis 2034. | Der schnelle Modus |

| Branchenriesen setzen es intensiv ein | Hyperscaler: Große Abnehmer wie AWS, Microsoft, Meta und Oracle setzen groß angelegte GPU-Cluster ein. Beispiel: NVIDIA-Projekte, die rund 2,5 Millionen Blackwell-GPUs (GB200) im Jahr 2025 allein für diese großen Technologieunternehmen. | IDTechEx, Zeitschrift für Signalintegrität |

Leistung pro Watt: Intelligenter, nicht nur schneller

Es geht nicht nur um die reine Geschwindigkeit, sondern auch um die Effizienz. Ein Grafikprozessor scheint zwar groß und leistungsfähig zu sein, aber für die spezifischen Arbeitslasten, die wir besprochen haben, ist er tatsächlich energieeffizienter als ein entsprechendes CPU-Array. Denken Sie darüber nach: Ein Grafikprozessor erledigt eine komplexe Aufgabe viel schneller, was bedeutet, dass er die Gesamtzeit - und den Energieverbrauch - reduziert. Server-PC-Gehäuse zum Betrieb benötigt. Dies hilft den Rechenzentren, ihre immensen Betriebskosten zu senken. Diese Kennzahl, Leistung pro Watt, ist das, was Ihrem CFO wirklich am Herzen liegt.

Reale Szenarien, die GPU-Leistung erfordern

Die Vorteile gehen weit über ein einzelnes Labor oder eine Forschungseinrichtung hinaus. Jede Branche findet neue Szenarien wo diese Technologie einen entscheidenden Wettbewerbsvorteil bietet.

Von generativer KI zu Big Data Crunching

Wenn man von Large Language Models (LLMs) oder generativer KI hört, spricht man von einer GPU-Auslastung. Diese komplexen Modelle benötigen zum Lernen eine immense Rechenleistung. Dies ist der Punkt, an dem ein GPU-optimiertes Gehäuse mit hoher Dichte wirklich glänzt.

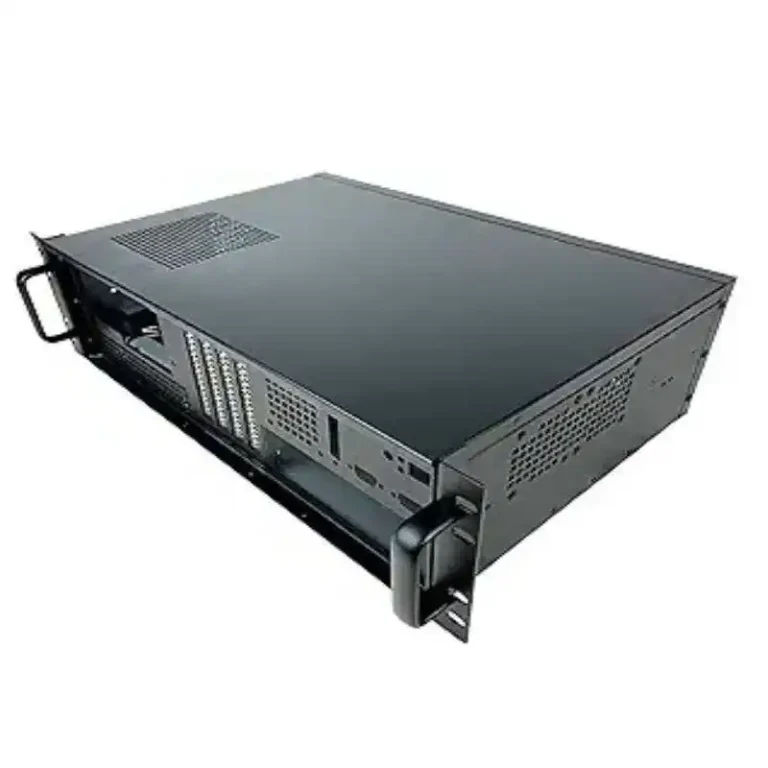

Rechenzentren und Algorithmuszentren benötigen eine Lösung, die ein Maximum an leistungsstarken GPUs auf kleinstem Raum unterbringt. Sie haben nicht unendlich viel Platz zur Verfügung, daher ist die Maximierung der Rechenleistung eine wichtige betriebliche Priorität. Die richtige server rack pc gehäuse sorgt für die nötige Kühlung und Stromversorgung und ermöglicht so die Durchführung umfangreicher KI-Trainingsaufgaben. [Link zu GPU-Server-Gehäusen]

Denken Sie an die Finanzmodellierung, die Arzneimittelentdeckung oder die Wettervorhersage. Diese verwendet müssen Petabytes von Daten schnell durchforstet und modelliert werden. Die Fähigkeit, diese Daten parallel zu verarbeiten, ist die einzige Möglichkeit, diese Fristen einzuhalten. Für viele Entwickler und Forschungseinrichtungen ist eine zuverlässige Computergehäuse Server die mehrere High-End-GPUs unterstützt, ist der Unterschied zwischen Spitzenreiter und Schlusslicht.

Jenseits des Chips: Die entscheidende Rolle des Servergehäuses

Sie können die beste GPU der Welt kaufen, aber wenn Sie sie in ein schlecht konstruiertes Gehäuse stecken, wird sie versagen. Deshalb ist die physische Hardware - die atx-Server-Gehäuse selbst - so wichtig ist. Es handelt sich nicht nur um einen Metallkasten, sondern um ein hochentwickeltes System, das Silizium im Wert von Millionen von Dollar schützt und kühlt.

Dichte und Wärmemanagement sind Ihre größten Herausforderungen

Dies ist der Grund, warum Hersteller wie Istonecase einsteigen. Wir bieten nicht nur Boxen; wir entwickeln die Grundlage für High-Performance-Computing. Für Großabnehmer - ob Großunternehmen oder Rechenzentrumsdienstleister - benötigen Sie eine Lösung, die die GPU-Dichte maximiert und gleichzeitig die starke Wärmeentwicklung bewältigt.

Ob Sie einen spezialisierten GPU-Server-Gehäuse [Link zu Rackmount Cases], ein Standard-Industriegehäuse Gehäuse für Wandmontage für Edge Computing [Link zu Wallmount Cases], oder sogar eine robuste NAS-Geräte Gehäuses muss das thermische Design einwandfrei sein. Wir sind auf OEM/ODM-Lösungen spezialisiert, d. h. wir können den Luftstrom, die Stromverteilung und sogar die Fahrgestellführungsschiene System nach Ihren genauen, strengen Spezifikationen [Link zu OEM/ODM Services]. Unser Fokus auf Qualität und Langlebigkeit bedeutet, dass Ihre Investition sicher ist und Ihre Leistung hoch bleibt.

Wir wissen, dass Sie vor einer großen Herausforderung stehen. Gegenwind Platz und Energie, daher entwerfen wir unsere Server-Gehäuse Produkte, die Ihnen den Wettbewerbsvorteil Rückenwind Sie benötigen.

Das Fazit: Bleiben Sie nicht zurück

Das Wachstum des GPU-optimierten Rechenzentrums ist eine Gewissheit. Die massive Nutzung durch Hyperscaler bestätigt, dass es sich hierbei nicht nur um einen Nischenmarkt handelt, sondern um den wichtigsten Weg in die Zukunft.

Wenn Sie ein IT-Dienstleister, eine Datenbankfirma oder ein Unternehmen sind, das seine nächste Computererweiterung plant, sollten Sie muss berücksichtigen eine Strategie, bei der die GPU im Vordergrund steht. Sie brauchen einen Partner, der die Komplexität von Wärmemanagement und High-Density-Design versteht. Genau das tun wir. Wir bieten die qualitativ hochwertigen, zuverlässigen und anpassbaren Server-Gehäuse Lösungen, die Sie für den Aufbau der nächsten Generation von Computing-Infrastrukturen benötigen [Link zu Server Cases].

Warten Sie nicht, bis Ihre Konkurrenten Daten mit der zehnfachen Geschwindigkeit verarbeiten. Holen Sie sich jetzt den richtigen Rahmen [Link zum ITX-Gehäuse], und stärken Sie Ihre Zukunft mit optimierter Hardware [Link zur Gehäuseführungsschiene].