Si hoy ejecutas cargas de trabajo en la GPU, ya lo notas: cajas de formación y cuadros de inferencia no se comportan igual.

Así que tampoco tiene sentido poner ambos en exactamente el mismo chasis por defecto.

A continuación repasamos los aspectos reales que deciden tu elección de caja pc rack servidor o caja pc servidor para cada carga de trabajo, con puntos concretos, una tabla y algunas escenas del mundo real.

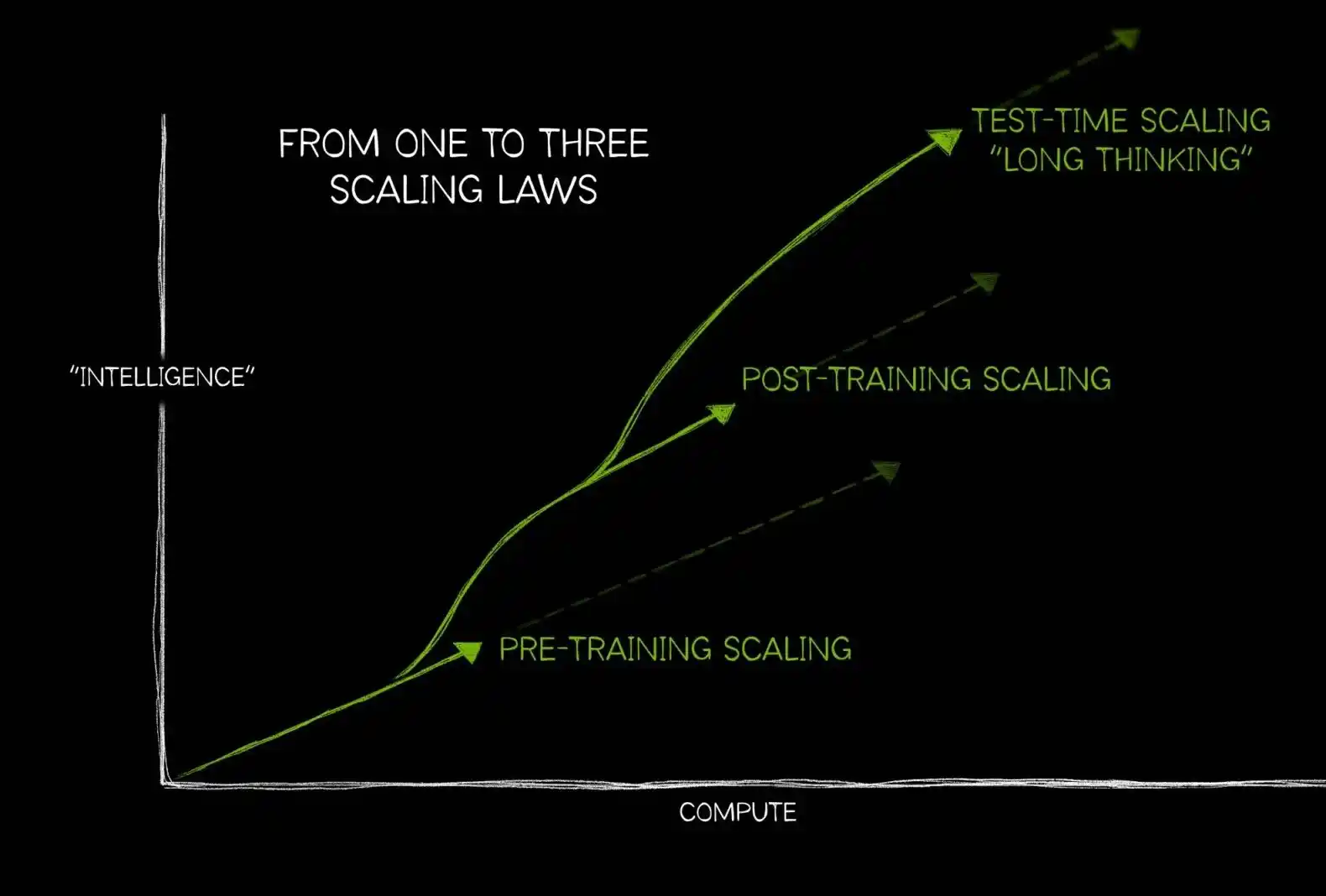

Entrenamiento de IA frente a inferencia: Diferentes cargas, diferentes opciones de PC servidor

Hagámoslo sencillo.

- Sistemas de formación

- Trabajos largos, de días o semanas.

- Matemáticas pesadas, grandes conjuntos de datos en flujo continuo.

- Objetivo: terminar la época más rápido, exprimir cada bit de las GPUs.

- Sistemas de inferencia

- Peticiones cortas, muchos usuarios.

- Cada llamada es pequeña, pero el QPS es alto.

- Objetivo: baja latencia, SLA estable, buen coste por petición.

Por eso, rara vez se diseña el mismo caja del ordenador servidor para ambos:

- Deseos de formación nodos GPU densos dentro de una caja rack profunda, alto flujo de aire, presupuesto de energía loco.

- La inferencia a menudo quiere nodos 1U/2U más delgados o incluso cajas de borde, fáciles de desplegar en muchos sitios.

Para clientes como centros de datos, centros de algoritmos, grandes empresas, proveedores de servicios de TI e incluso desarrolladores aficionados, esta diferencia afecta a la vida diaria de O&M: alarmas térmicas, equipos ruidosos, cajas difíciles de mantener, jungla de cables... todo empieza con la elección incorrecta del chasis.

Densidad de GPU y diseño térmico en una carcasa de PC para rack de servidor

Cuando se habla de formación, se habla de Densidad de GPU y envoltura térmica primero.

El chasis debe sobrevivir a eso, no sólo pasar las especificaciones sobre el papel.

Sistemas de formación: Muchas GPU y mucho calor en una carcasa de PC para rack de servidor

Nodo de entrenamiento típico:

- 4-8 GPU de longitud y altura completas.

- Muy profundo caja pc rack servidor, a menudo 4U y superiores.

- Alto flujo de aire de adelante hacia atrás, pared del ventilador, tal vez líquido listo.

- Limpia la distribución interna de las tarjetas riser y el cableado, o te cargas tú solito el flujo de aire.

Qué debe ofrecer el chasis:

- Fuerte entrada frontal, gran pared de ventilador en el centro, túnel de aire recto a través de todas las GPU.

- Espacio para grandes fuentes de alimentación y cobre.

- Estructura rígida, porque una Servidor GPU es pesado y no quieres que los raíles se doblen.

Aquí es donde un especialista caja para montaje en bastidor de un fabricante como IStoneCase tiene sentido. Necesitas a alguien que diseñe en función de la longitud de la GPU, los elevadores PCIe y el tendido de cables, no sólo en función de “lo que cabe en el papel”.

Sistemas de inferencia: Computación más eficiente y cargas de trabajo mixtas

Los nodos de inferencia son más diversos:

- A veces, 1-2 GPU más una CPU rápida.

- A veces pura CPU, pero mucha memoria y NVMe rápido.

- A menudo 1U/2U o chasis de poca profundidad si se despliega en salas de borde.

Aquí la caja:

- Puede ser más delgado, pero aún necesita flujo de aire dirigido en la GPU única.

- Necesita más opciones de E/S (NIC adicionales, serie, quizá puertos heredados) para la integración con otros equipos.

- Debería ser más fácil de mantener, porque puede tener muchos sitios pequeños, no sólo un gran DC.

Un compacto caja pc servidor o Caja ITX con una buena gestión frontal de E/S y cables ya resuelve muchos puntos problemáticos para los MSP y los equipos de TI pequeños.

Chasis de formación frente a chasis de inferencia: Principales diferencias

Puedes colocar esta tabla en documentos internos o en tu propia cubierta.

| Aspecto | Chasis del sistema de formación AI | Chasis del sistema de inferencia de IA |

|---|---|---|

| Objetivo principal | Máximo rendimiento, termina las épocas más rápido | Baja latencia, alto QPS, servicio estable |

| Factor de forma típico | 4U (o superior) caja del ordenador servidor con profundidad de estantería | 1U / 2U, de poca profundidad, a veces de montaje en pared o ITX |

| Recuento de GPU | 4-8 GPU de alta potencia por nodo | 0-2 GPUs, a veces muchos nodos ligeros en su lugar |

| Flujo de aire | Entrada frontal grande, pared de ventilador, flujo de aire estricto de adelante hacia atrás, tal vez preparado para bucle de líquido. | Flujo de aire concentrado en menos puntos calientes, control de ruido y polvo para el borde |

| Potencia | Fuentes de alimentación masivas, picos de consumo elevados, barras colectoras pesadas | Fuentes de alimentación moderadas, centradas en la eficiencia y el cableado sencillo |

| Disposición del almacén | Numerosas bahías de intercambio en caliente para carga de datos y puntos de control | Pocos NVMe/M.2 rápidos para pesos y registros de modelos |

| Red | Múltiples NIC de alta velocidad para el tráfico este-oeste entre nodos | Más puertos para tráfico norte-sur, equilibradores de carga, dispositivos de borde |

| Capacidad de servicio | A menudo gestionado por equipos pro DC, se sigue tolerando un MTTR más largo | Necesita un intercambio rápido de ventiladores, fuentes de alimentación y discos, y un MTTR bajo en las sucursales. |

Alimentación, refrigeración y disposición en el interior de una caja de ordenador servidor

La alimentación y la refrigeración es donde muchos proyectos se vuelven dolorosos.

Cajas de entrenamiento: Grandes fuentes de alimentación, cables feos si el diseño es malo

Para la formación:

- Las fuentes de alimentación son grandes y pesadas.

- Los cables son gruesos.

- Los conectores de GPU consumen espacio rápidamente.

Si el chasis no planea ubicación PSU y canales de cable, se obtiene:

- Flujo de aire bloqueado.

- Puntos calientes cerca de los VRM.

- Difícil de cerrar el panel lateral después de una pequeña actualización.

Un fabricante OEM/ODM como IStoneCase puede retocar:

- Posición de la fuente de alimentación (frontal, trasera, doble fuente)

- Orificios para el paso de cables y puntos de anclaje

- Espacio extra cerca de los elevadores PCIe

Así que su alta densidad caja del ordenador servidor sigue siendo útil después de la 10ª modificación de campo.

Cajas de inferencia: Refrigeración para el mundo real, no sólo para el laboratorio

Los nodos de inferencia viven en lugares como:

- Racks de oficina pequeños con gestión de cables desordenada.

- Armarios de borde con poco pasillo frío/calor.

- Locales comerciales o industriales con polvo y vibraciones.

Aquí, el chasis debe:

- Utiliza más filtros de polvo y un panel frontal de fácil limpieza.

- Soporta ventiladores más silenciosos, o al menos el ajuste de la curva del ventilador.

- Mantenga caminos despejados alrededor de las zonas calientes de GPU/CPU incluso en 1U.

Podrías elegir un Carcasa ATX para servidor para un rack de derivación, con suficiente espacio trasero para cables y un sencillo carril guía del chasis kit para sacar la caja en segundos. Ese pequeño detalle hace que los equipos de operación y mantenimiento estén mucho más contentos.

Del centro de datos a la periferia: opciones de carcasas de servidor para montaje en bastidor, en pared e ITX

No todas las cargas se ejecutan en un gran centro de datos.

Aquí es donde entran en juego las diferentes familias de chasis.

Cajas de montaje en bastidor para formación e inferencia pesada

Para big data center o centro de algoritmos:

- 19″ caja para montaje en bastidor es la línea de base.

- Chasis profundo de 4U para nodos de formación.

- Clúster 1U/2U de nodos de inferencia bajo el mismo conmutador de la parte superior del bastidor.

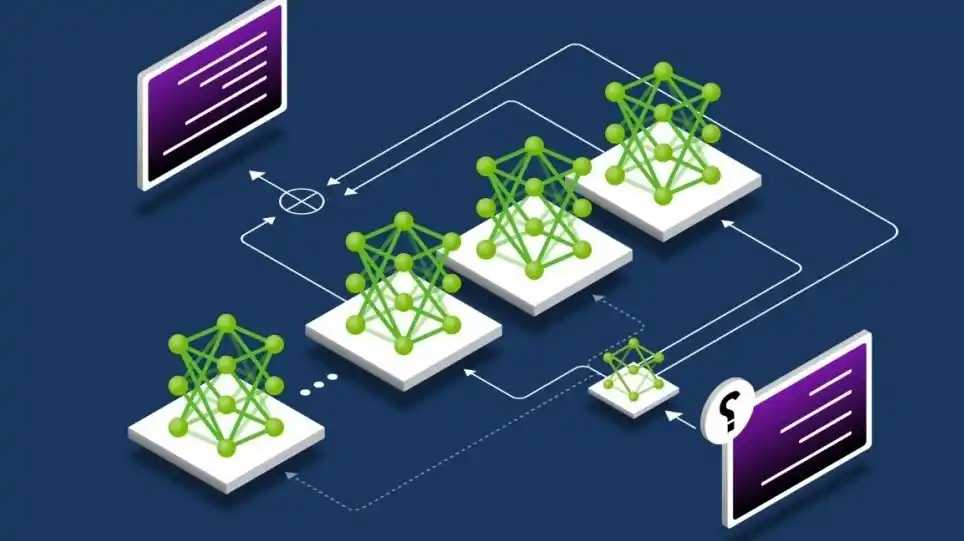

Normalmente se combinan:

- Cajas de formación GPU en formato 4U.

- Nodos API, pasarelas, bases de datos en 1U/2U.

- Almacenamiento compartido en chasis NAS o JBOD dedicados.

Un proveedor como IStoneCase puede suministrar tanto el pesado Servidor GPU y más ligero caja pc rack servidor para los servicios circundantes, con el mismo estilo de placa frontal para que su bastidor tenga un aspecto limpio y “de la misma familia”.

Dispositivos NAS y de montaje en pared para Edge Inference

Para medianas empresas, comercios, edificios inteligentes e incluso laboratorios de investigación:

- Las cajas de montaje en pared mantienen los equipos alejados del suelo, son buenas contra el polvo y las “patadas aleatorias”.

- Pequeño Dispositivos NAS gestionar registros locales, vídeo y telemetría.

- El nodo de inferencia de bordes se ejecuta dentro de un nodo compacto caja pc servidor o Dispositivos NAS chasis con una GPU.

Esto te da:

- Trayecto corto desde la cámara o el sensor hasta el nodo de inferencia.

- Menor dependencia de la WAN.

- Mantenimiento in situ sencillo, ya que se puede acceder a toda la caja sin necesidad de deslizar una pesada 4U.

ITX y factor de forma pequeño para desarrolladores y POC

Los equipos de desarrollo y los entusiastas técnicos adoran las cajas pequeñas pero serias:

- Placas Mini-ITX o micro-ATX.

- Una GPU decente.

- Lo suficientemente silencioso como para sentarse debajo del escritorio.

Una buena construcción Caja ITX le permite realizar un entrenamiento real en pequeños conjuntos de datos y pruebas de inferencia realistas sin llenar un rack completo. Más adelante, cuando se amplíe el centro de datos, basta con trasladar la carga de trabajo a un rack más grande. caja pc rack servidor diseño.

Cómo IStoneCase apoya los proyectos de chasis de formación e inferencia de IA

IStoneCase se posiciona como:

"Fabricante líder mundial de soluciones OEM/ODM para chasis de almacenamiento y carcasas de GPU/servidores"

En la práctica, eso significa:

- Puede obtener Casos de servidores GPU, caso del servidor, caja para montaje en bastidor, estuche de pared, Dispositivos NAS, Caja ITX y carril guía del chasis kits.

- También puede solicitar un panel frontal personalizado, bahías adicionales, una ubicación diferente de la fuente de alimentación, una profundidad extraña, un flujo de aire único e incluso una pintura especial si realmente lo desea.

Para los proyectos de formación en IA, IStoneCase puede:

- Proporcionar 4U de profundidad caja del ordenador servidor opciones ajustadas para multi-GPU, grandes PSU y aire de adelante hacia atrás.

- Te ayuda a mantener el espacio adecuado entre GPUs y el enrutamiento de los risers para evitar el ahogo térmico y los problemas de señal.

Para los despliegues de inferencia, especialmente a escala:

- ATX delgado y de poca profundidad servidor atx caso diseños se adaptan a estanterías estrechas y salas de bordes.

- Los chasis de montaje en pared y estilo NAS resuelven los problemas de “no disponer de bastidor pero seguir necesitando un servidor”.

- Las opciones OEM/ODM facilitan el envío de la misma referencia de chasis a muchas sucursales y socios.

Ya sea un operador de centros de datos, un proveedor de servicios de bases de datos, un instituto de investigación o una pequeña tienda de servicios informáticos, el chasis no es sólo metálico.

Es una parte real de su tiempo de actividad, de su carga de trabajo in situ y de su imagen de marca cuando los clientes entran en la sala de equipos.

Elige los casos de entrenamiento e inferencia teniendo esto en cuenta y todo el conjunto, desde la GPU hasta el kit de raíles, funcionará mejor.